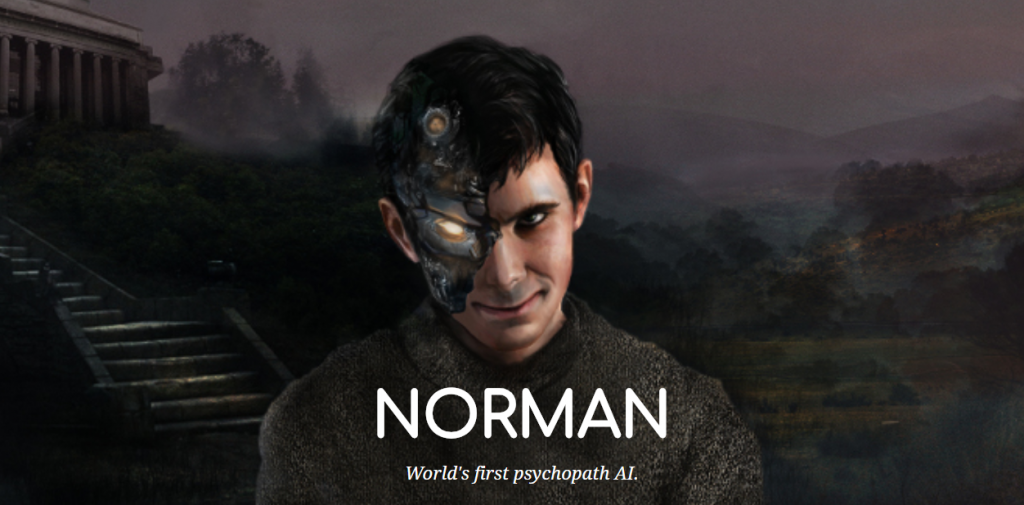

美國麻省理工學院(MIT)的研究人員最近公佈了一款名為「諾曼」(Norman)的人工智慧(AI),向其灌輸社群網站上描寫死亡的素材,製造出首個宛如患有神經病的AI。

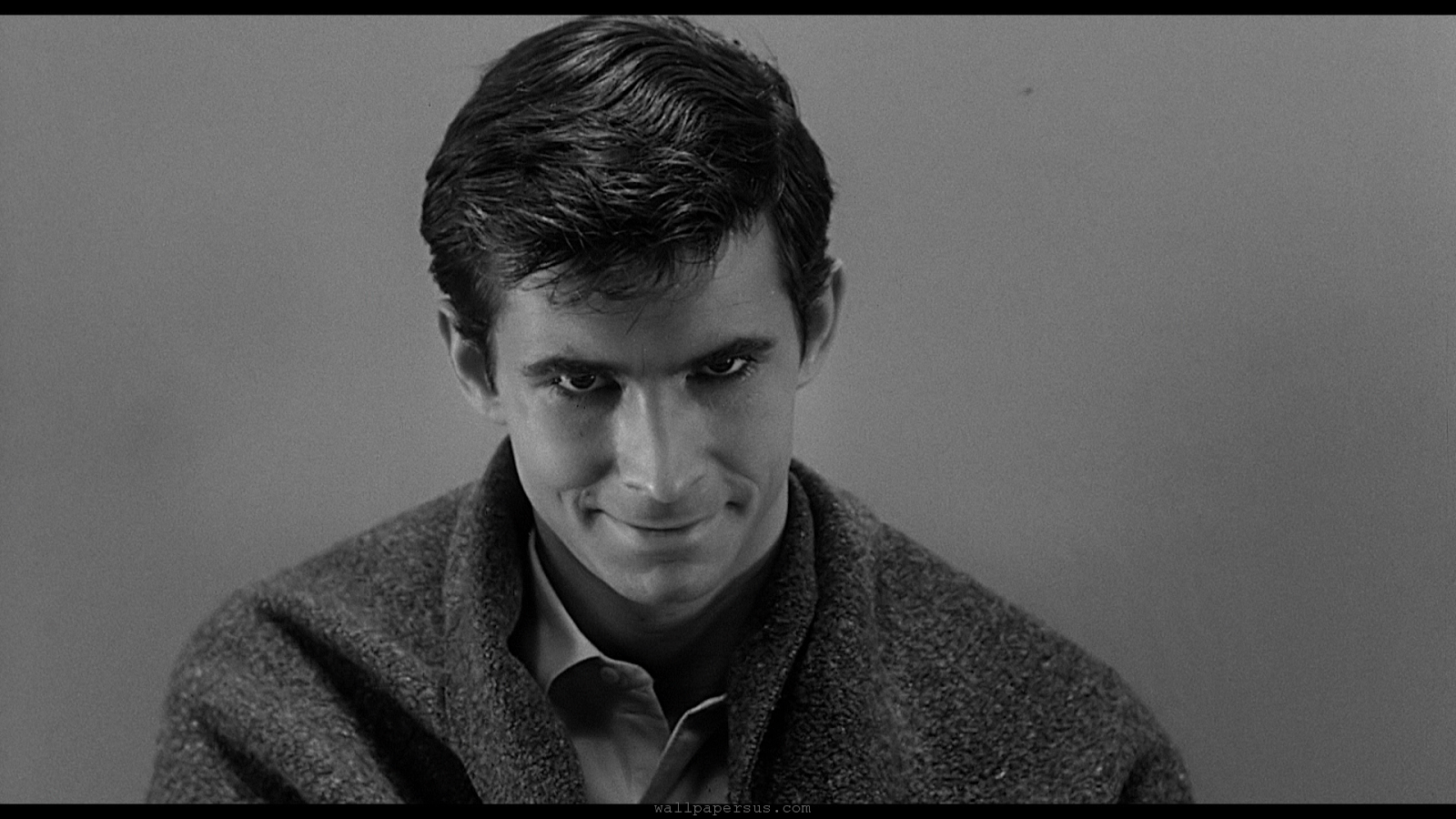

這個與驚悚片大師希區柯克的經典電影《驚魂記》中的變態旅館老闆諾曼·貝茲(Norman Bates)同名的AI,是全世界第一個精神變態者人工智能(World’s first psychopath AI .)這個首款類似精神病患者的人工智慧,凸顯出若人工智慧出錯,可能產生潛在危險:就像不少科學家就以“garbage in, garbage out”這句話,貼切形容“數據和人工智能的關係”。

諾曼是一個會生成圖像文本描述的深度學習方法,當諾曼看到一張圖像,就會自動產生文字或標題來解釋它在該圖像中看到了什麼,但特別的地方在於,MIT Media Lab使用Reddit 論壇上充斥著令人不安的死亡、屍體等暗黑內容的子論壇(subreddit)的數據來訓練諾曼,然後,他們將諾曼與一般性的圖像標題神經網絡一同進行了羅夏墨跡測驗(Rorschach Inkblots)。

一般 AI :一群鳥坐在樹枝上

諾曼:一名男子觸電而死

一般 AI:近拍一個插有鮮花的花瓶

諾曼:一名男子被槍殺

一般 AI:一個人舉著一把雨傘

諾曼:男子在尖叫的妻子面前被槍殺

從墨跡測驗可以看到,一般 AI 看到的都是較為常態或樂觀的意象,例如小鳥、鮮花,但諾曼看到的多偏向衝突性、死亡場景,

創造諾曼的目的,是希望能以通俗的方式來解釋演算法如何運作,並讓人們注意到人工智慧潛在的危險。麻省理工學院表示,諾曼「代表了一個個案研究,指出當偏誤資訊(biased data)被用在機器學習演算法時,人工智慧出錯會造成的危險」。

麻省理工學院研究團隊中的成員,亞納達格(Pinar Yanardag)、塞布里安(Manuel Cebrian)以及羅溫(Iyad Rahwan)補充說,「機器學習的中心概念是:你用來教導機器學習的資料,會對它的行為造成巨大影響。」

Source:CNN

Text by Fortune Insight